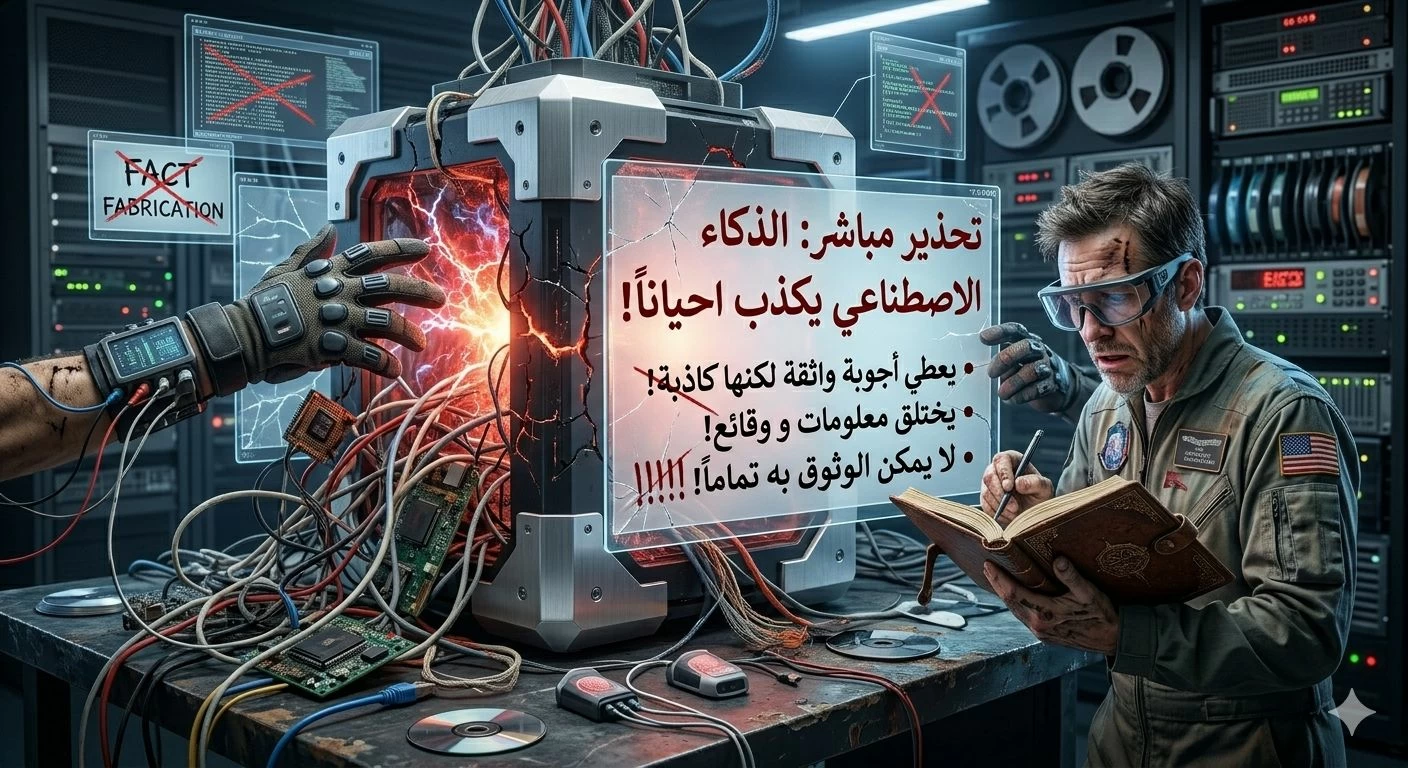

La confiance croissante des utilisateurs dans l'intelligence artificielle entraîne des décisions basées sur des informations inexactes. En 2024, 47% des utilisateurs d'IA en entreprise ont pris des décisions fondées sur des contenus trompeurs. Parallèlement, les employés passent entre 3 et 4 heures par semaine à vérifier les résultats de ces systèmes.

L'outil qui était censé faire gagner du temps consomme désormais ce temps à corriger ses erreurs. Ce phénomène suscite des inquiétudes, surtout dans une région où l'utilisation de cette technologie est fragile.

Détails de l'événement

Dans notre région, la fragilité est exacerbée par le fait que la plupart des modèles d'intelligence artificielle sont formés sur du contenu en anglais. Lorsque ces modèles fonctionnent en arabe, la probabilité d'erreur augmente considérablement. Par exemple, un étudiant peut recevoir des références inventées avec des noms arabes convaincants, ou un patient peut obtenir un diagnostic médical qui semble précis mais qui est en réalité fabriqué. De même, un avocat qui se fie à l'intelligence artificielle peut présenter un jugement qui n'existe dans aucun registre légal.

Cette fragilité n'a pas encore été discutée suffisamment sérieusement, soulevant des questions sur la fiabilité de ces systèmes dans la prise de décisions de vie.

Contexte et arrière-plan

L'intelligence artificielle aujourd'hui est un outil en cours de maturation, et il ne faut pas la rejeter ni lui confier les clés de la maison. Des études montrent que les meilleurs modèles ont réduit le taux de hallucination de 21% en 2021 à moins de 1% dans certaines tâches, ce qui démontre un véritable progrès dans ce domaine.

Cependant, la question la plus importante n'est pas de savoir à quel point la machine ment, mais comment les mensonges accumulés, considérés comme des vérités, influencent les modèles plus intelligents qui les apprennent et les reproduisent avec une plus grande confiance.

Conséquences et impact

Ce phénomène nécessite une attention particulière de la part des décideurs politiques et des utilisateurs. L'ignorance des risques potentiels peut conduire à des décisions erronées affectant la santé, les finances et les questions juridiques.

Il est important de poser la question : qui détient la réponse aujourd'hui ? Qui y pense ? Jusqu'à présent, il ne semble pas y avoir de réponses claires ou de solutions proposées.

Impact sur la région arabe

Dans le monde arabe, où la dépendance à la technologie augmente, il est essentiel d'avoir une conscience accrue des risques liés à l'utilisation de l'intelligence artificielle. Il est crucial de mieux former les modèles sur la langue et la culture arabes pour réduire les erreurs.

En conclusion, nous devons être prudents dans l'utilisation de cette technologie et chercher des moyens d'assurer sa précision et sa fiabilité avant de l'utiliser pour prendre des décisions importantes.